Prompt:大语言模型的执行指南

TL;DR

提示词(Prompt)是指由用户或系统提供给大语言模型(Large Language Model, LLM)的一段文字或问题,模型在这些给定信息(又称上下文)下,生成相关的回复或文本。Prompt作为大语言模型的执行指南,其好坏直接影响大语言模型的生成效果,但问题在于不知道如何创作高质量的 Prompt,比如:完成一个Prompt需要哪些要素?这些要素要用什么样的话术来描述?用何种顺序或结构来组织多个要素?写完Prompt后,怎么评估其有效性?如果效果不好,可以从哪些方面进行改进?本文就这些问题,整理了一些Prompt工程相关的资料,希望通过吸取他人经验、结合个人实践经历,总结创作Prompt工程的方法论。

在本文中,可以了解到以下内容:

TL;DR

问题:大语言模型的能力限制

创作原则:六条来自OpenAI的GPT最佳实践

结构化Prompt:Prompt工程师的“八股文”

鲜明的特点和优势

要素与组织结构

创作的合理顺序

构建结构化Prompt真正重要的事

自动化开发和调优

最佳实践

思考:再看结构化Prompt

几种Prompt的设计策略

启动大语言模型能力 ...

【转载】大语言模型在1688电商场景的算法实践

转载自闲记算法 - lonePatient

【梳理】陆奇最新演讲实录:我的大模型世界观

TL;DR

我们面临这样一个时代的机会。它既是机会,也是挑战。我们建议你就这个机会做全方位思考。 —— 陆奇

陆奇是中国著名的企业家和技术领袖,现任奇绩创坛董事长。他曾经担任过百度公司CEO和微软公司全球副总裁等职务,是中国互联网和人工智能领域的重要人物之一。陆奇在百度任职期间,带领公司实现了从搜索引擎到人工智能的转型,并推动了百度在人工智能领域的创新和发展。他在人工智能、大数据和云计算等领域拥有深厚的技术背景和丰富的管理经验,被誉为“中国人工智能第一人”。2018年,陆奇创办了奇绩创坛,旨在为创新企业提供技术、资金和市场等全方位支持,推动中国科技创新的发展。奇绩创坛已经成为中国创新创业领域的重要力量,陆奇也因此被誉为中国创新创业领域的领军人物之一。

面对当前全世界对大模型的高度关注,他做了“我的大模型世界观”的演讲,其中分享了他对大模型时代的宏观思考.他指出,技术的进步驱动着人类社会结构和范式的不断更迭。我们目前正处于一个新范式的重要拐点,其中包括信息生态系统、模型系统和行动系统三个体系的组合。我们已经走过了信息无处不在的互联网范式阶段。在当前阶段中,“模型”知识无处不在,基于 ...

【转载】ChatGPT 标注指南:任务、数据与规范

TL;DR

转载自ChatGPT 标注指南:任务、数据与规范 - Yam

ChatGPT 刚刚出来时,业内人士一致认为高质量的数据是一个非常关键的因素。且不论这个结论在 ChatGPT 这里是否正确,但高质量的数据对模型大有裨益却是公认的。而且,我们也可以从公开的 InstructGPT 标注指南中对此窥探一二。本文主要就围绕这份指南进行介绍,有点标题党了,但是考虑到 ChatGPT 和 InstructGPT 是兄弟关系,我们有理由相信 ChatGPT 的标注也是基于 InstructGPT 给出的指南进行的。当然不一定是全部,但至少我们可以从中学习和借鉴一些东西,是有此文。

本文主要包括以下几个方面内容:

总体介绍:我们首先会简单介绍 ChatGPT 训练过程中的几个涉及到标注的任务,清楚了任务才能更好地了解标注。然后从宏观角度统领几个方面的设计,包括数据、人员、规范等。

标注数据:包括数据收集、数据分析、数据预处理等。

标注人员:包括人员筛选、人员特征、满意度调查等。

标注规范:包括关键指标、标注方法细则、标注示例、FAQ 等。

多想一点:主要是个人的一些补充和思考。

总 ...

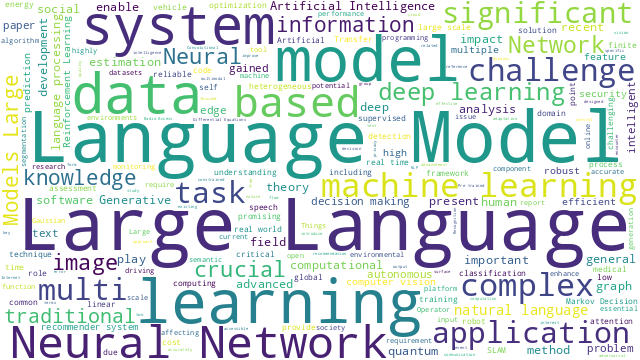

【转载】通向AGI之路:大型语言模型(LLM)技术精要

转载自通向AGI之路:大型语言模型(LLM)技术精要 - 知乎/张俊林

目前规模最大的LLM模型,几乎清一色都是类似GPT 3.0这种“自回归语言模型+Prompting”模式的,比如GPT 3、PaLM、GLaM、Gopher、Chinchilla、MT-NLG、LaMDA等,没有例外。为什么会这样呢?

自然语言生成任务,在表现形式上可以兼容自然语言理解任务,若反过来,则很难做到这一点。这样的好处是:同一个LLM生成模型,可以解决几乎所有NLP问题。而如果仍然采取Bert模式,则这个LLM模型无法很好处理生成任务。既然这样,我们当然倾向于使用生成模型,这是一个原因。

现在已有研究(参考:On the Role of Bidirectionality in Language Model Pre-Training)证明:如果是以fine-tuning方式解决下游任务,Bert模式的效果优于GPT模式;若是以zero shot/few shot prompting这种模式解决下游任务,则GPT模式效果要优于Bert模式。这说明了,生成模型更容易做好zero shot/few sho ...

这是一份给算法同学的强化学习入门材料

Part 1:基本概念

概念

强化学习

强化学习关注与智能体(agent)如何与环境交互中不断学习以完成特定的目标;

与有监督学习相比,不需要告诉智能体数据以及对应的标签,学习相应的模型,而是需要智能体在环境中一次次学习(哪些数据对应哪些标签),从而学习规律知道策略;

强化学习是希望智能体在环境中根据当前状态,采取行动,转移到下一个状态,获得回报。不断进行这样的过程,从而学习到一个策略(状态到动作的映射,即当前状态下,采取什么样的行动,能使得我最终获得的回报最大【不仅只是当前状态的而回报,一个策略的长期影响才是至关重要的】)

(s1)→a1(s2/r1)→a2(s3/r2)→a3(s4/r3)→⋯(s_1) \rightarrow^{a_1} (s_2/r_1) \rightarrow^{a_2} (s_3/r_2) \rightarrow^{a_3} (s_4/r_3) \rightarrow \cdots

(s1)→a1(s2/r1)→a2(s3/r2)→a3(s4/r3)→⋯

交互对象

智能体(agent):可以感知外界环境的状态(state)和反馈 ...

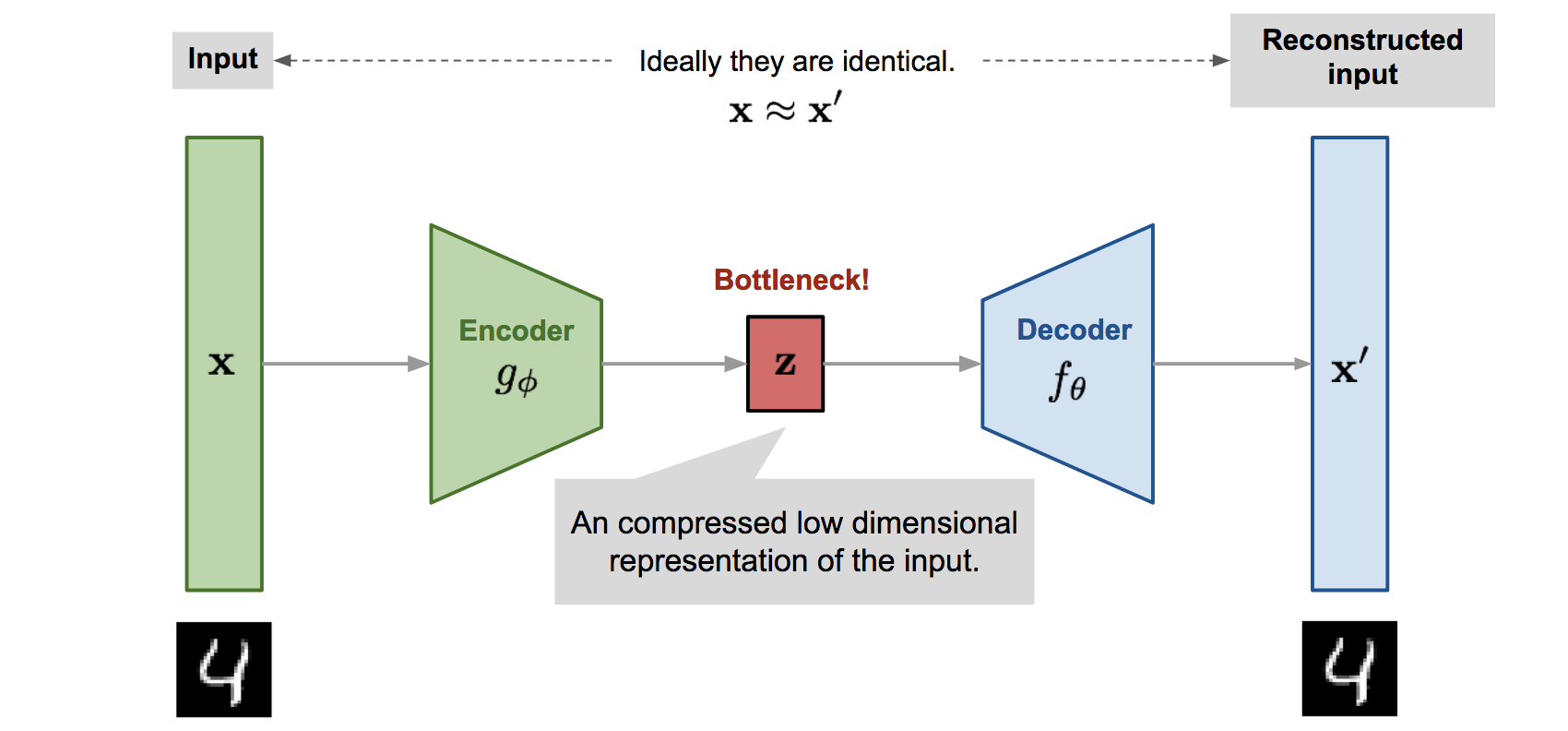

变分自编码器(Variational AutoEncoder)

TL;DR

最近,AIGC是极火热的讨论话题,而文生图可以说是AIGC的代表性工作。目前,效果最好的文生图模型是基于扩散模型的,当进一步深入扩散模型时,又对他的损失函数产生了很大的疑问。通过查找各方资料,才发现扩散模型与变分自编码器在损失定义上同出一门,理解了变分自编码器的损失自然也能理解扩散模型的损失。

另外,变分自编码器已经作为基础模型,集成到许多后续工作中,例如:

Stable Diffusion用变分自编码器获取图片的潜在表征(latents)进行前向扩散,避免直接在像素空间中前向扩散,极大地提升了计算效率;

作为变分自编码器的拓展性工作,向量化离散变分自编码器(Vector Quantised-Variational AutoEncoder, VQ-VAE)已经被广泛用作图像分词器,如BEIT、DALL·E等。

可以说,变分自编码器是过不去的一个坎,极有必要对变分自编码器做细致的了解。

但是,查阅已有资料发现,有关变分自编码器的教程总是伴随复杂的公式推导,而实现的代码又难以与公式严格对应。另外,理论部分还涉及变分推断、ELBO、重参数等等多种技巧,让人摸不着头脑。本文将从 ...

transformers.generation.GenerationMixin

当谈到文本生成时,Transformer API是目前最受欢迎的NLP工具之一。 它提供了各种解码策略和参数,使用户可以自定义生成的文本。在本文中,我们将学习如何使用Transformer API生成文本。

基本使用

在使用Transformer API之前,需要安装PyTorch和Transformers包:

1$ pip install torch transformers

完成安装后,可以使用以下代码导入所需的模块:

1from transformers import pipeline, set_seed

其中pipeline模块提供了生成文本所需的所有功能,而set_seed允许我们设置随机种子以获得可重复的结果。

以下是一段文本生成的例子:

12345678910# 设置随机种子以获得可重复的结果set_seed(42)# 加载文本生成器pipelinegenerator = pipeline('text-generation', model='gpt2')# 生成文本text = generator('The quick b ...

升级深度学习开发环境全攻略

前言

配置过深度学习开发环境的同学都知道,这是一项繁琐工作,稍不注意就会发生问题。首先,要熟悉硬件配置以选择对应的软件版本。例如,RTX3090刚推出时,TensorFlow只支持CUDA10,但该显卡必须安装CUDA11,所以想要在RTX3090上使用TensorFlow,需安装nightly版本。其次,即使软件与硬件契合,在安装时也要考虑软件间的依赖问题。以PyTorch的torch-1.13.0-cp37-cp37m-manylinux1_x86_64.whl为例,该版本要求python为3.7.x、系统为32位或64位的linux,还要求计算机已安装对应版本的CUDA。

配置环境也是一项机械的工作,我相信每位同学安装环境前,都会在百度搜索框搜索“深度学习环境安装”,根据网上整理的博客、攻略,查找各软件的安装指令,磕磕碰碰地进行环境配置。有时候装的过程中才发现,资料内容是关于旧版本的,而新版本安装方式早已更新,想必此时各位内心有一万头X泥马奔腾而过……

所以,为了避免在配置环境上花费太多时间,我每次配置完环境后,很长一段时间不会更新(系统安装后自动更新就已被关闭)。但是随着技术 ...

2022全球人工智能技术创新大赛(GAIIC2022):商品标题实体识别(二等奖)

本方案由大华DahuaKG团队提供,在本次竞赛中本方案获二等奖。DahuaKG团队由来自浙江大华技术股份有限公司大数据研究院知识图谱团队的成员组成,大华知识图谱团队专注于行业知识图谱构建和自然语言处理等技术的研究与应用,并致力于相关技术在语义检索、信息提取、文本理解、图挖掘、智能交互等任务上完成产业落地,为大华数据智能解决方案提供NLP和知识图谱相关领域的算法支撑。

整体上,我们基于预训练语言模型NeZha构建商品标题实体识别模型,通过继续预训练加微调的训练范式学习模型参数,并有效结合数据增强、损失函数优化、对抗训练等手段逐步提升模型性能。该方案简单有效,复现流程不超过36小时,线上推断1万条样本仅需254秒(NVIDIA T4,单卡)。

赛题介绍

赛题链接:https://www.heywhale.com/home/competition/620b34ed28270b0017b823ad

本赛题要求选手用模型抽取出商品标题文本中的关键信息,是典型的命名实体识别任务。要求准确抽取商品标题中的相关实体,有助于提升检索、推荐等业务场景下的用户体验和平台效率,是电商平台一项核心的基础任务。

...