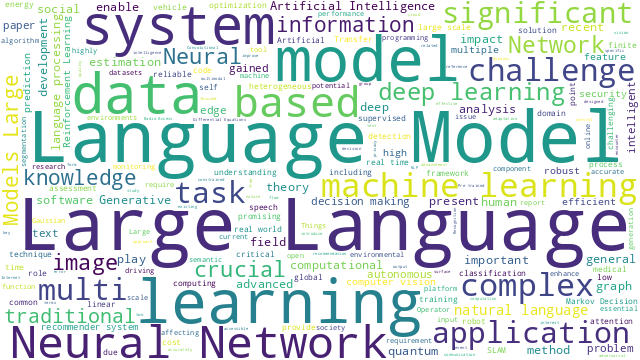

Arxiv每日速递(2026-06-10)

本篇博文主要展示每日从Arxiv论文网站获取的最新论文列表,以自然语言处理、信息检索、计算机视觉等类目进行划分。

统计

今日共更新775篇论文,其中:

自然语言处理115篇

信息检索20篇

计算机视觉123篇

自然语言处理

1. 【2606.11189】A Unifying Lens on Supervised Fine-Tuning Through Target Distribution Design

链接:https://arxiv.org/abs/2606.11189

作者:Tong Xie,Yuanhao Ban,Yunqi Hong,Sohyun An,Yihang Chen,Cho-Jui Hsieh

类目:Machine Learning (cs.LG); Artificial Intelligence (cs.AI); Computation and Language (cs.CL)

关键词:Supervised fine-tuning, typically maximizes, demonstrated trajectory, maximiz ...

TrendPulse 技术趋势追踪报告

目录

2026-06-08

2026-06-01

2026-05-29

2026-05-22

2026-05-15

2026-05-08

2026-05-01

2026-04-29

2026-04-22

2026-06-08

概览

本期报告共整合 3 个数据源的热点分析:

数据源

分析项目数

分析时间

GitHub 开源热点

20

2026-06-08 04:45

HackerNews 技术热点

20

2026-06-08 04:48

HuggingFace 论文热点

20

2026-06-08 04:42

GitHub 开源热点

1. 开源趋势洞察

AI范式跃迁:从“参数内卷”到“技能策展”与“品味治理”。大模型基础能力趋于收敛后,开源社区的重心正迅速向应用层质量与交互人格迁移。taste-skill2 直指“AI生成内容平庸化”痛点,通过注入审美与判断层过滤机械式输出;而 colleague-skill6 与 agency-agents-zh18 则将AI能力封装为即插即用的“数字同事”与垂直专家角色。这标志着工程实践正从Prompt Engin ...

LLM Wiki 深度解读:让大语言模型成为你的知识编译器

本文是对 Andrej Karpathy 提出的 LLM Wiki 范式的深度解读与实现设计。Karpathy 前特斯拉 AI 总监、OpenAI 联合创始人,其技术洞察一向以简洁深刻著称。LLM Wiki 是他对个人知识管理的一次范式级思考,值得每一位深度使用 LLM 的人理解。

原文出处: https://gist.github.com/karpathy/442a6bf555914893e9891c11519de94f

原文与精译对照

.bilingual-section { margin: 1.5em 0; }

.bilingual-grid { display: grid; grid-template-columns: 1fr 1fr; gap: 0; }

.bilingual-cell { padding: 1em 1.2em; line-height: 1.7; }

.bilingual-cell.source { background: #fafbfc; }

.bilingual-cell.translation { background: #fff; }

.bi ...

Superpowers:AI Agent 系统化软件开发方法论

这不是一篇普通的工具介绍。这是一套强制 AI 在动手前先想清楚的纪律体系——14 个可组合的 skills,把 “收到任务就写代码” 的本能反应,改造成 “先设计、再计划、再执行、再验证” 的工程流程。读完这篇,你会理解为什么把这套方法叫做 Superpowers。

Superpowers 是什么

Superpowers 是一个AI 编程代理的软件开发方法论套件,以可组合的 skills 文件为载体,通过一套强制性的指令协议,把 AI 从"收到任务就写代码"的反应式代理,转变为"先设计、再计划、再执行、再验证"的系统化工程师。

它不是某个 IDE 的插件,也不是一个 CLI 工具——它是一个跨平台的行为框架,通过同一套 skills 目录同时支持 Claude Code、Codex、Cursor、OpenCode、Gemini CLI 和 GitHub Copilot CLI。

核心机制很简单:

Skills 是可组合的流程单元 — 每个 skill 是一个 Markdown 文件(SKILL.md),包含特定场景下的完整工作流

1% 规则强制 ...

Project Interview Skill:用一场对话,把模糊的项目变成结构清晰的文档

一、这是什么

我创建了 project-interview 技能,一个通过交互式问答采访,引导用户把项目信息梳理成结构化文档的 AI 助手。

它的工作方式很像一位经验丰富的项目顾问:先自己做功课(看代码、读文档、翻 Git 历史),然后跟你聊几个关键问题,最后输出一份结构完整的 Markdown 项目文档。

🔗 源码与使用说明:https://github.com/isLouisHsu/skills/tree/main/skills/project-interview

与普通的"AI 帮我写文档"不同,它解决的核心问题是**“我不知道该写什么”**。它不是等你给出一堆材料再整理,而是主动引导你——从项目背景到技术决策,从团队分工到踩过的坑,通过层层递进的对话,把你脑子里零散的项目信息一点点"问"出来,再组织成文档。

文档结构根据项目体量自动适配:

小型项目(工具脚本、小模块):项目概述 + 使用方法 + 技术要点,1-2 页

中型项目(独立应用、服务):覆盖核心章节,3-5 页

大型项目(平台、系统):完整章节结构,言之有物即可

章节涵 ...

Project Docs Manager Skill:让 AI 自主驱动项目迭代的文档引擎

一、这是什么

我创建了 project-docs-manager 技能,以标准化流程维护结构化项目文档库,帮助 AI 自主理解项目全貌、历史决策与当前状态。该技能遵循「单一事实源」「机器可读优先」「闭环自更新」三大原则,支持本地目录、Obsidian、云端文档等多种媒介,并内置初始化、迭代记录、状态查询等完整工作流。

它不只是一个文档管理工具。它要实现的是在项目中建立一套结构化文档体系,充当 AI 的"项目记忆"和"驱动引擎",从而让 AI 能够自主地理解项目现状、提出优化方向、执行变更、回收效果、沉淀知识,然后基于新的认知发起下一轮迭代——全程不依赖人类重新交代背景。

这背后是一种范式的根本转变。 传统开发以代码为中心,人花大部分时间写代码、调模型、配部署。但在 AI 时代,这个关系颠倒了——文档成为中心,代码、模型、配置只是文档的附属产物。你把目标和大致的想法写进文档,AI 读取后设计方案、生成代码、训练模型、部署服务、回收指标。 Project Docs Manager 就是要把这套 “文档驱动” 的工作流固化下来,让 AI 真正具备自主驱 ...

Video Knowledge Purify Skill:让视频变成可检索的结构化知识笔记

一、这是什么

video-knowledge-purify 技能,用于将视频内容自动转换为结构化的 Markdown 知识笔记。它的核心流程只有三步:转录 → 分段 → 汇总。

🔗 源码与使用说明:https://github.com/isLouisHsu/skills/tree/main/skills/video-knowledge-purify

你丢给它一个视频文件(或者已有 SRT 字幕),它会自动完成以下工作:

音频转录:把视频中的语音转为带时间戳的 SRT 字幕;

内容分段:调用文本 LLM 按语义主题切分字幕,识别知识点边界;

内容汇总:调用 VLM 结合字幕文本和视频关键帧,逐段生成 Markdown 笔记。

最终输出是一份可直接导入 Obsidian、Notion 或任何 Markdown 知识库的 note.md,每个段落都标注了时间范围,并配有对应的关键帧图片。

二、为什么需要这个 Skill

视频是高质量知识源,但消费和沉淀的成本极高。

视频不适合快速检索和复习。B站、YouTube、知识付费课程里有大量干货,但视频形态决定了你无法像搜索文档一样快速 ...

Claude Code 的 Agent Harness 工程

TL;DR

Agent Harness 是围绕大模型构建的运行时基础设施,负责管理 Agent 的生命周期、上下文状态、工具调用链路与执行安全。本文以 Claude Code 为范本,拆解其七个核心工程机制:执行循环(感知—推理—行动—观测的 while 闭环)、原子化工具集(bash/文件操作按需组合)、动态技能加载(目录常驻+内容按需注入)、三层上下文压缩(微观清理→阈值重置→模型主动压缩)、Human-in-the-loop 审批(高风险操作前插入人工确认节点)、任务编排(会话内 todo 列表 + 跨会话带依赖图的持久化任务系统),以及多智能体协作(一次性 Subagent 上下文隔离 + 持久化 Agent Teams 邮箱通信)。这些机制共同解决了 Agent 工程化落地中最核心的几个问题:任务不丢失、上下文不爆炸、执行可审计、复杂任务可拆解、多 Agent 可协同。

本文所涉及的代码示例全部来自 shareAI-lab/learn-claude-code 仓库,一个按难度递进展示 Agent Harness 核心机制的教学项目。

从工作流到 Harness Engin ...

通过 Frozen Lake 理解 PPO 与 GRPO

引言

大型语言模型(LLM)的强化学习训练流程往往涉及复杂的分布式采样、大规模策略网络和高维奖励建模,初学者很容易迷失在工程细节中。为了剥离这些干扰,本文借助 OpenAI Gym 中经典的 Frozen Lake(冰湖) 环境,结合一份精简但功能完整的代码实现,深入剖析两种主流策略优化算法:PPO(Proximal Policy Optimization) 和 GRPO(Group Relative Policy Optimization)。我们将聚焦于它们的核心——优势函数(Advantage Estimation) 的构建逻辑,并解释其背后的动机与数学形式。

Frozen Lake 环境简介

Frozen Lake 是一个网格世界(Grid World)任务:

状态空间:智能体位于 N times N 网格中的某个格子,用整数索引表示(如 0 到 N^2 - 1)。

动作空间:上下左右四个方向移动(离散动作,共 4 个)。

地图元素:

S:起点(Start)

F:安全冰面(Frozen)

H:冰窟(Hole),掉入即失败,奖励为 0

G:目标(Goal),到达即成功,奖励为 ...

多臂老虎机:UCB与Thompson采样

TL;DR

多臂老虎机问题是在有限尝试次数下,通过平衡探索(尝试未知选项)与利用(选择当前最优选项),最大化总奖励的经典决策问题。

UCB1(Upper Confidence Bound 1) 基于置信上界,对每个臂的估计奖励加上一个“不确定性”项,偏向乐观选择;理论保证强,但探索略显保守。

汤普森采样(Thompson Sampling)采用贝叶斯方法,从每个臂的后验分布中采样并选择最大者,实现“按需探索”,自适应性强。

在实验中(4臂、5000步、最优臂 p=0.637):

汤普森采样的总悔憾仅15.6,远低于UCB1的59.8;

更快锁定最优臂(<500步 vs. ~1000步);

非最优臂尝试次数更少(32次 vs. 123次)。

汤普森采样在实际应用中通常更高效、更智能,是工业界首选;UCB1则胜在理论清晰,适合分析场景。

什么是多臂老虎机问题?

有一排老虎机,每一台机器(称为一个“臂”)拉一次会以某个未知概率吐出硬币(奖励为 1),否则什么也没有(奖励为 0)。你的目标是在有限次数(比如 5000 次)内,尽可能多地获得硬币。

多臂老虎机问题

有 KKK ...